目录

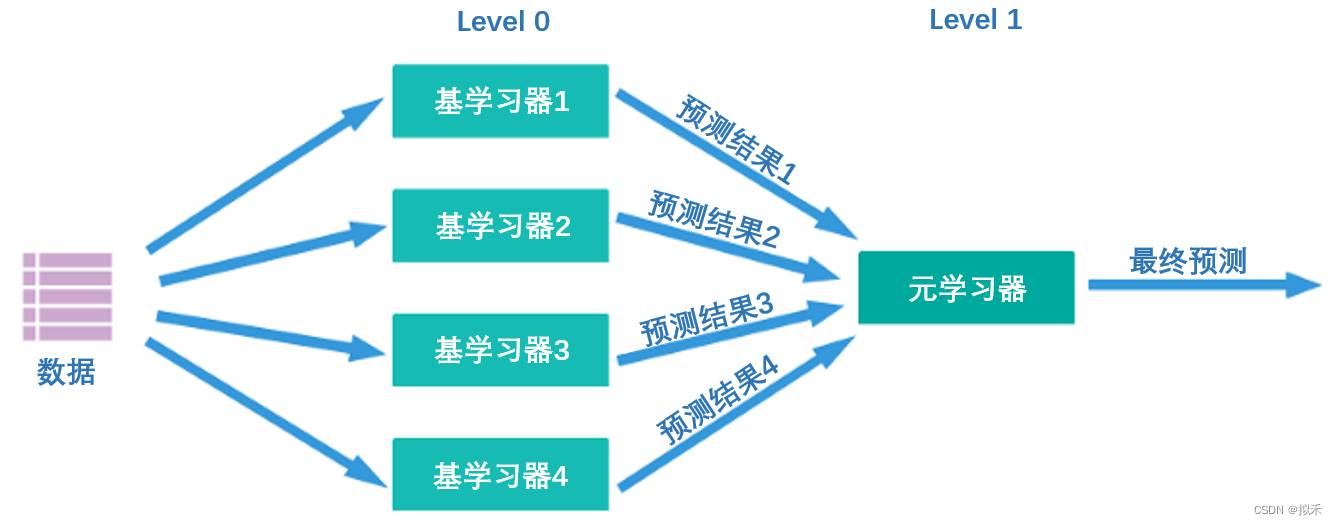

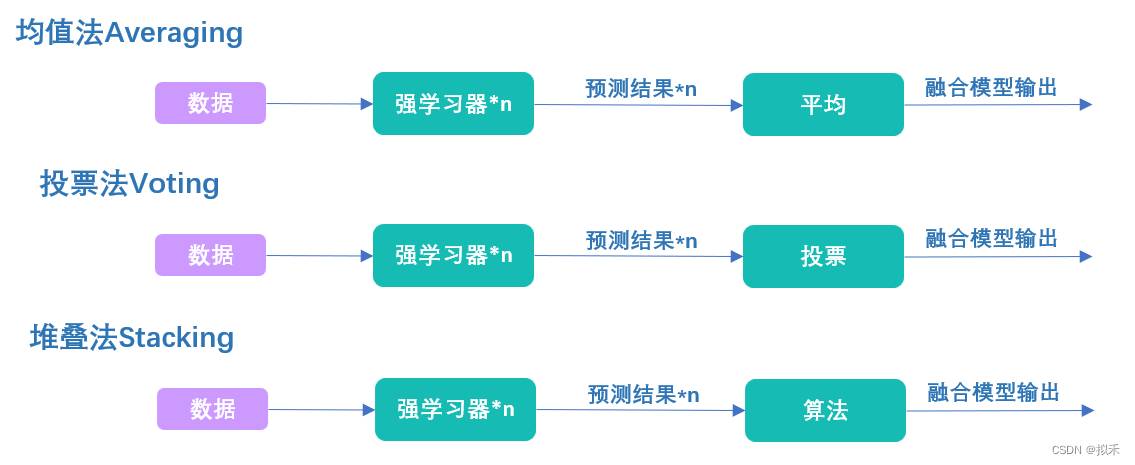

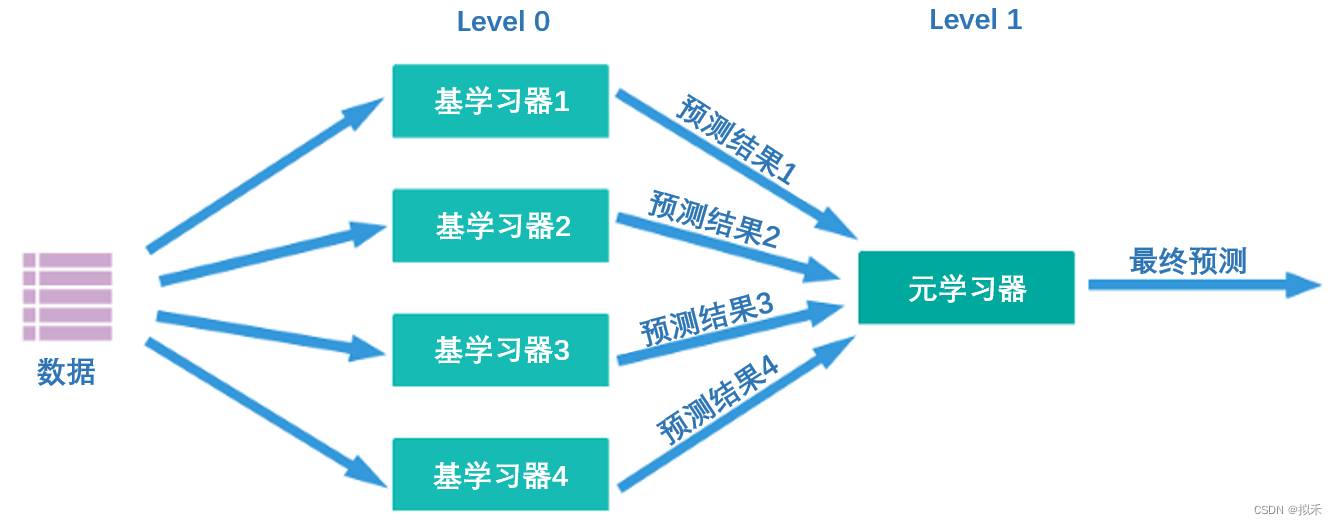

1、Stacking的基本思想💍

2、思考💎

3、在sklearn中实现Stacking🎯

3.1、导入工具库和数据👕

3.2、定义交叉验证评估函数👗

3.3、个体学习器与元学习器的定义🍗

3.4、模型构建🍪

4、元学习器的特征矩阵🍒

4.1、特征矩阵存在的问题🍓

4.2、样本量太少的解决方案:交叉验证🍌

4.3、特征太少的解决方案🍎

4.4、接口 transform 与属性 stack_method_🍅

5、Stacking融合的训练和测试流程🎪

本文完整实战代码获取:模型融合实战Stacking和Blending - 知乎 (zhihu.com)

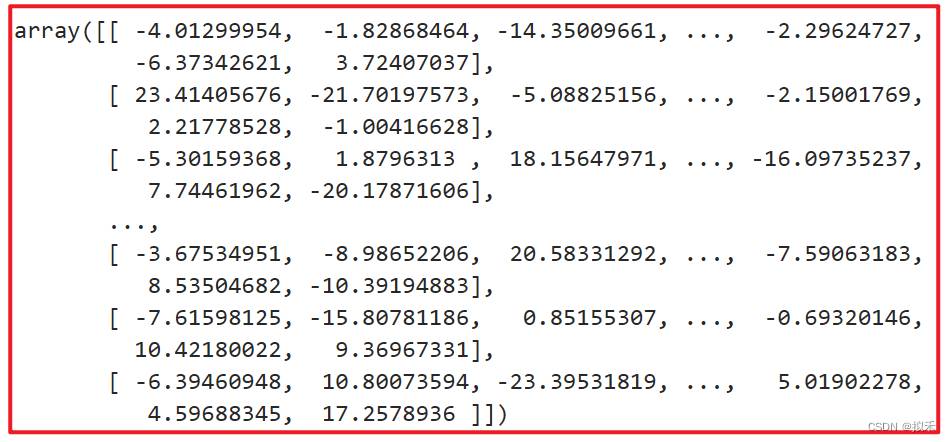

在这个过程中,level 0输出的预测结果一般如下排布:

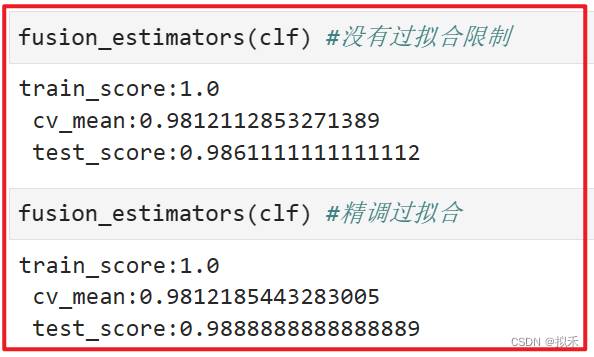

要不要对融合的算法进行精密的调参?

个体学习器粗调,元学习器精调,如果不过拟合的话,可以两类学习器都精调。理论上来说,算法输出结果越接近真实标签越好,但个体学习器精调后再融合,很容易过拟合。

个体学习器算法要怎样选择才能最大化stacking的效果?

与投票、平均的状况一致,控制过拟合、增加多样性、注意算法整体的运算时间。

个体学习器可以是逻辑回归、决策树这种复杂度较低的算法吗?元学习器可以是xgboost这种复杂度很高的算法吗?

都可以,一切以模型效果为准。对level 0而言,当增加弱学习器来增加模型多样性、且弱学习器的效果比较好时,可以保留这些算法。对level 1而言,只要不过拟合,可以使用任何算法。个人推荐,在分类的时候可以使用复杂度较高的算法,对回归最好还是使用简单的算法。

level 0和level 1的算法可不可以使用不同的损失函数?

可以,因为不同的损失函数衡量的其实是类似的差异:即真实值与预测值之间的差异。不过不同的损失对于差异的敏感性不同,如果可能的话建议使用相似的损失函数。

level 0和level 1的算法可不可以使用不同的评估指标?

个人建议level 0与level 1上的算法必须使用相同的模型评估指标。虽然Stacking中串联了两组算法,但这两组算法的训练却是完全分离的。在深度学习当中,我们也有类似的强大算法串联弱小算法的结构,例如,卷积神经网络就是由强大的卷积层与弱小的线性层串联,卷积层的主要职责是找出特征与标签之间的假设,而线性层的主要职责是整合假设、进行输出。但在深度学习中,一个网络上所有层的训练是同时进行的,每次降低损失函数时需要更新整个网络上的权重。但在Stacking当中,level 1上的算法在调整权重时,完全不影响level 0的结果,因此为了保证两组算法最终融合后能够得到我们想要的结果,在训练时一定要以唯一评估指标为基准进行训练。

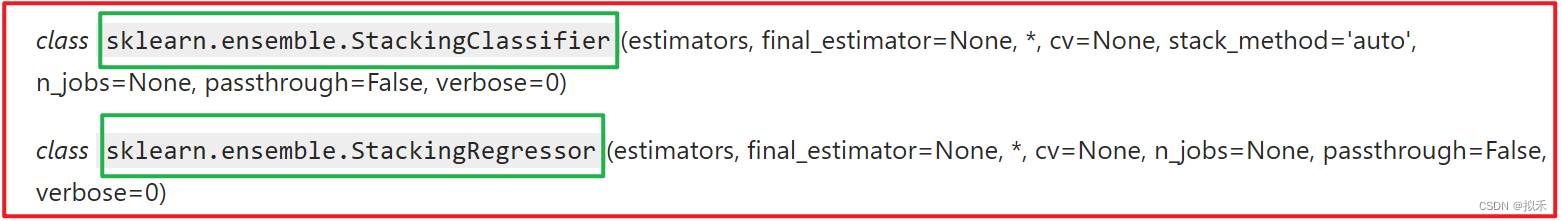

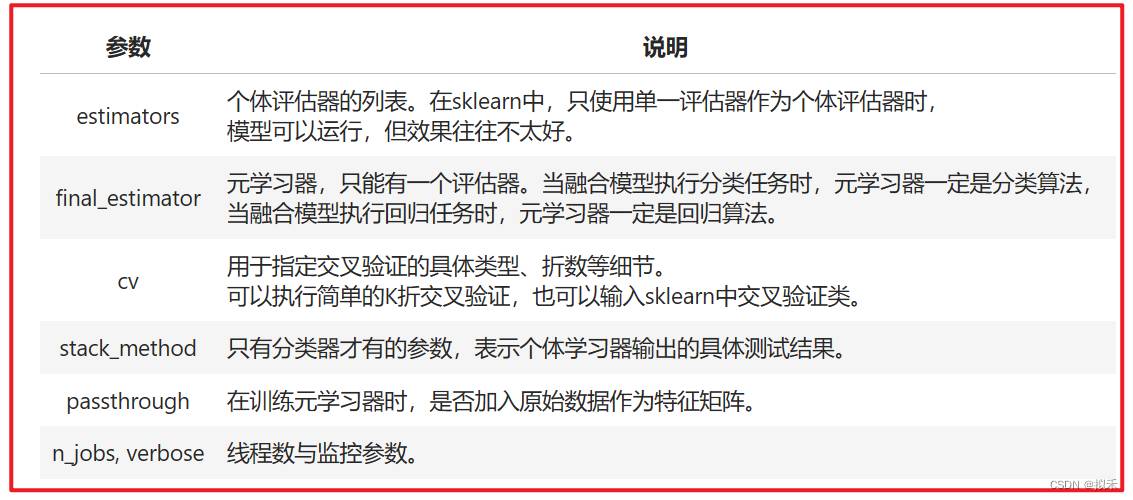

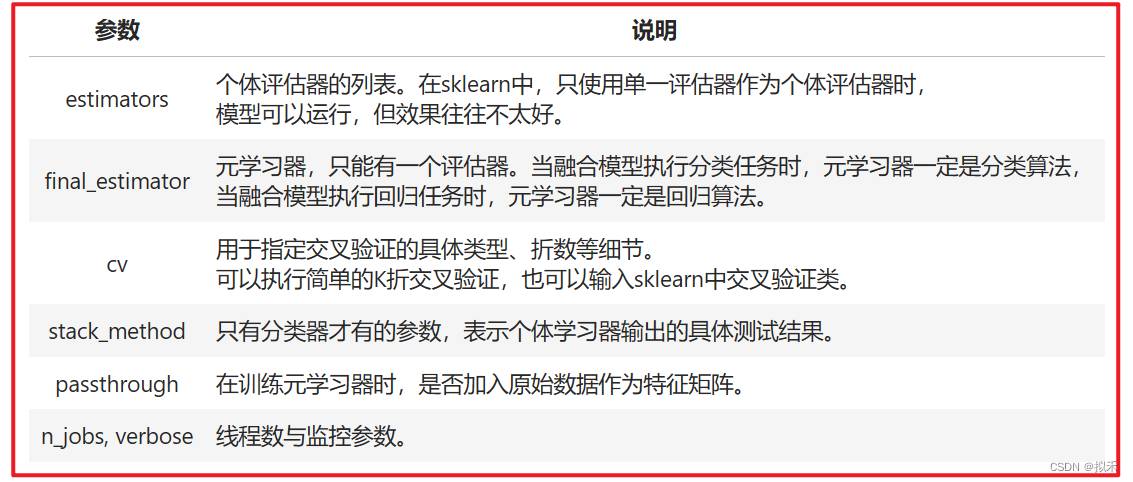

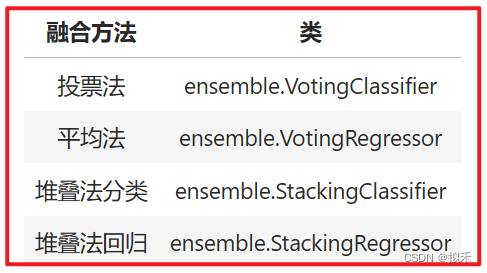

显然,StackingClassifier应用于分类问题,StackingRegressor应用于回归问题。

在sklearn当中,只要输入estimators和final_estimator,就可以执行stacking了。我们可以沿用在投票法中使用过的个体学习器组合,并使用随机森林作为元学习器来完成stacking

#常用工具库

import re

import numpy as np

import pandas as pd

import matplotlib as mlp

import matplotlib.pyplot as plt

import time

#算法辅助 & 数据

import sklearn

from sklearn.model_selection import KFold, cross_validate

from sklearn.datasets import load_digits #分类 - 手写数字数据集

from sklearn.datasets import load_iris

from sklearn.datasets import load_boston

from sklearn.model_selection import train_test_split

#算法(单一学习器)

from sklearn.neighbors import KNeighborsClassifier as KNNC

from sklearn.neighbors import KNeighborsRegressor as KNNR

from sklearn.tree import DecisionTreeRegressor as DTR

from sklearn.tree import DecisionTreeClassifier as DTC

from sklearn.linear_model import LinearRegression as LR

from sklearn.linear_model import LogisticRegression as LogiR

from sklearn.ensemble import RandomForestRegressor as RFR

from sklearn.ensemble import RandomForestClassifier as RFC

from sklearn.ensemble import GradientBoostingRegressor as GBR

from sklearn.ensemble import GradientBoostingClassifier as GBC

from sklearn.naive_bayes import GaussianNB

import xgboost as xgb

#融合模型

from sklearn.ensemble import StackingClassifier使用sklearn自带的手写数字数据集,是一个10分类数据集。

data = load_digits()

X = data.data

y = data.target

# 划分数据集

Xtrain,Xtest,Ytrain,Ytest = train_test_split(X,y,test_size=0.2,random_state=1412)def fusion_estimators(clf):

"""

对融合模型做交叉验证,对融合模型的表现进行评估

"""

cv = KFold(n_splits=5,shuffle=True,random_state=1412)

results = cross_validate(clf,Xtrain,Ytrain

,cv = cv

,scoring = "accuracy"

,n_jobs = -1

,return_train_score = True

,verbose=False)

test = clf.fit(Xtrain,Ytrain).score(Xtest,Ytest)

print("train_score:{}".format(results["train_score"].mean())

,"\n cv_mean:{}".format(results["test_score"].mean())

,"\n test_score:{}".format(test)

)

def individual_estimators(estimators):

"""

对模型融合中每个评估器做交叉验证,对单一评估器的表现进行评估

"""

for estimator in estimators:

cv = KFold(n_splits=5,shuffle=True,random_state=1412)

results = cross_validate(estimator[1],Xtrain,Ytrain

,cv = cv

,scoring = "accuracy"

,n_jobs = -1

,return_train_score = True

,verbose=False)

test = estimator[1].fit(Xtrain,Ytrain).score(Xtest,Ytest)

print(estimator[0]

,"\n train_score:{}".format(results["train_score"].mean())

,"\n cv_mean:{}".format(results["test_score"].mean())

,"\n test_score:{}".format(test)

,"\n")#逻辑回归没有增加多样性的选项

clf1 = LogiR(max_iter = 3000, C=0.1, random_state=1412,n_jobs=8)

#增加特征多样性与样本多样性

clf2 = RFC(n_estimators= 100,max_features="sqrt",max_samples=0.9, random_state=1412,n_jobs=8)

#特征多样性,稍微上调特征数量

clf3 = GBC(n_estimators= 100,max_features=16,random_state=1412)

#增加算法多样性,新增决策树与KNN

clf4 = DTC(max_depth=8,random_state=1412)

clf5 = KNNC(n_neighbors=10,n_jobs=8)

clf6 = GaussianNB()

#新增随机多样性,相同的算法更换随机数种子

clf7 = RFC(n_estimators= 100,max_features="sqrt",max_samples=0.9, random_state=4869,n_jobs=8)

clf8 = GBC(n_estimators= 100,max_features=16,random_state=4869)

estimators = [("Logistic Regression",clf1), ("RandomForest", clf2)

, ("GBDT",clf3), ("Decision Tree", clf4), ("KNN",clf5)

#, ("Bayes",clf6)

, ("RandomForest2", clf7), ("GBDT2", clf8)

]#选择单个评估器中分数最高的随机森林作为元学习器

#也可以尝试其他更简单的学习器

final_estimator = RFC(n_estimators=100

, min_impurity_decrease=0.0025

, random_state= 420, n_jobs=8)

clf = StackingClassifier(estimators=estimators #level0的7个体学习器

,final_estimator=final_estimator #level 1的元学习器

,n_jobs=8)

这里的精调过拟合的操作就是增加了参数:min_impurity_decrease=0.0025

可以看到,stacking在测试集上的分数与投票法Voting持平,但在5折交叉验证分数上却没有投票法高。这可能是由于现在我们训练的数据较为简单,但数据学习难度较大时,stacking的优势就会慢慢显现出来。当然,我们现在使用的元学习器几乎是默认参数,我们可以针对元学习器使用贝叶斯优化进行精妙的调参,然后再进行对比,堆叠法的效果可能超越投票法。

在Stacking过程中,个体学习器会原始数据上训练、预测,再把预测结果排布成新特征矩阵,放入元学习器进行学习。其中,个体学习器的预测结果、即元学习器需要训练的矩阵一般如下排布:

根据我们对机器学习以及模型融合的理解,不难发现以下两个问题:

1个个体学习器只能输出1组预测结果,我们对这些预测结果进行排列,新特征矩阵中的特征数就等于个体学习器的个数。一般融合模型中个体学习器最多有20-30个,也就是说元学习器的特征矩阵中最多也就20-30个特征。这个特征量对于工业、竞赛中的机器学习算法来说是远远不够的。

个体学习器的职责是找到原始数据与标签之间的假设,为了验证这个假设是否准确,我们需要查看的是个体学习器的泛化能力。只有当个体学习器的泛化能力较强时,我们才能安心的将个体学习器输出的预测结果放入元学习器中进行融合。

然而。在我们训练stacking模型时,我们一定是将原始数据集分为训练集、验证集和测试集三部分:

其中测试集是用于检测整个融合模型的效果的,因此在训练过程中不能使用。

而训练集用于训练个体学习器,属于已经完全透露给个体学习器的内容,如果在训练集上进行预测,那预测结果是“偏高”的、无法代表个体学习器的泛化能力。

因此最后剩下能够用来预测、还能代表个体学习器真实学习水平的,就只剩下很小的验证集了。一般验证集最多只占整个数据集的30%-40%,这意味着元学习器所使用的特征矩阵里的样本量最多也就是原始数据的40%。

无论在行业惯例当中,元学习器需要是一个复杂度较低的算法,因为元学习器的特征矩阵在特征量、样本量上都远远小于工业机器学习所要求的标准。为了解决这两个问题,在Stacking方法当中存在多种解决方案,而这些解决方案可以通过sklearn中的stacking类实现。

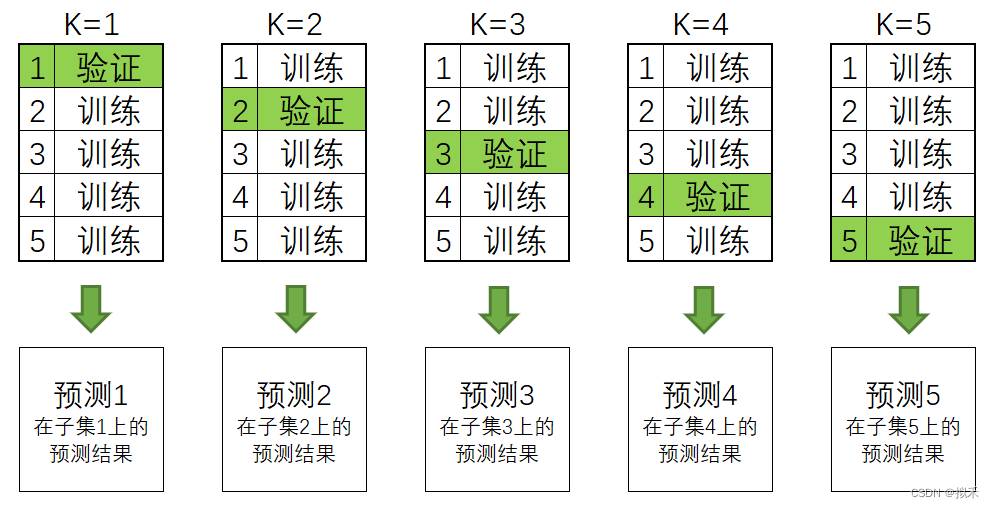

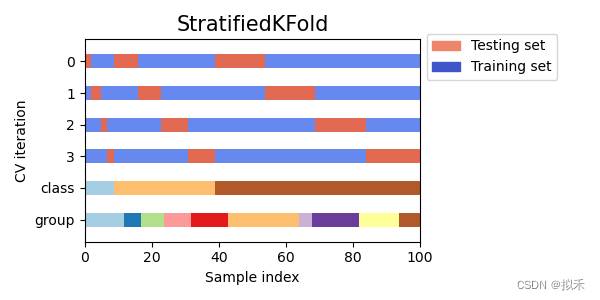

cv,在stacking中执行交叉验证

用这样的方法来进行预测,可以让任意个体学习器输出的预测值数量 = 样本量,如此,元学习器的特征矩阵的行数也就等于原始数据的样本量了:

在stacking过程中,这个交叉验证流程是一定会发生的,不属于我们可以人为干涉的范畴。不过,我们可以使用参数cv来决定具体要使用怎样的交叉验证,包括具体使用几折验证,是否考虑分类标签的分布等等。具体来说,参数cv中可以输入:

输入None,默认使用5折交叉验证

输入sklearn中任意交叉验证对象

输入任意整数,表示在Stratified K折验证中的折数。Stratified K折验证是会考虑标签中每个类别占比的交叉验证,如果选择Stratified K折交叉验证,那每次训练时交叉验证会保证原始标签中的类别比例 = 训练标签的类别比例 = 验证标签的类别比例。

现在你知道Stacking是如何处理元学习器的特征矩阵样本太少的问题了。需要再次强调的是,内部交叉验证的并不是在验证泛化能力,而是一个生产数据的工具,因此交叉验证本身没有太多可以调整的地方。唯一值得一提的是,当交叉验证的折数较大时,模型的抗体过拟合能力会上升、同时学习能力会略有下降。当交叉验证的折数很小时,模型更容易过拟合。但如果数据量足够大,那使用过多的交叉验证折数并不会带来好处,反而只会让训练时间增加而已。

estimators = [("Logistic Regression",clf1), ("RandomForest", clf2)

, ("GBDT",clf3), ("Decision Tree", clf4), ("KNN",clf5)

#, ("Bayes",clf6)

, ("RandomForest2", clf7), ("GBDT2", clf8)

]

final_estimator = RFC(n_estimators=100

, min_impurity_decrease=0.0025

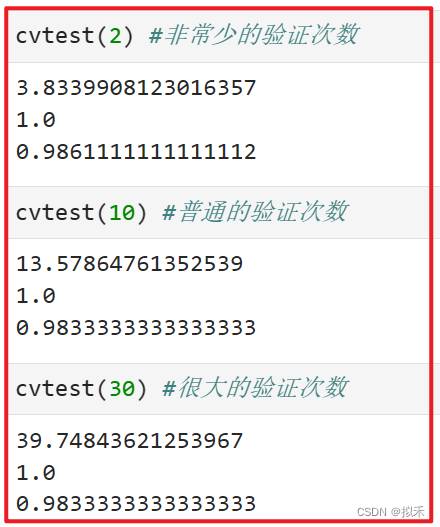

, random_state= 420, n_jobs=8)def cvtest(cv):

clf = StackingClassifier(estimators=estimators

,final_estimator=final_estimator

, cv = cv

, n_jobs=8)

start = time.time()

clf.fit(Xtrain,Ytrain)

print((time.time() - start)) #消耗时间

print(clf.score(Xtrain,Ytrain)) #训练集上的结果

print(clf.score(Xtest,Ytest)) #测试集上的结果

可以看到,随着cv中折数的上升,训练时间一定会上升,但是模型的表现却不一定。因此,选择5~10折交叉验证即可。同时,由于stacking当中自带交叉验证,又有元学习器这个算法,因此堆叠法的运行速度是比投票法、均值法缓慢很多的,这是stacking堆叠法不太人性化的地方。

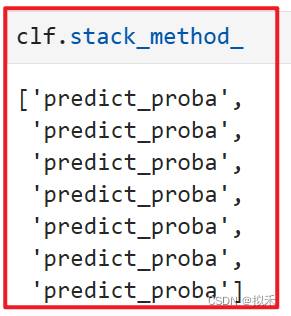

stack_method,更换个体学习器输出的结果类型stack_method控制,这是只有StackingClassifier才拥有的参数,它控制个体分类器具体的输出。stack_method里面可以输入四种字符串:"auto", "predict_proba", "decision_function", "predict",除了"auto"之外其他三个都是sklearn常见的接口。clf = LogiR(max_iter=3000, random_state=1412)

clf = clf.fit(Xtrain,Ytrain)

#predict_proba:输出概率值

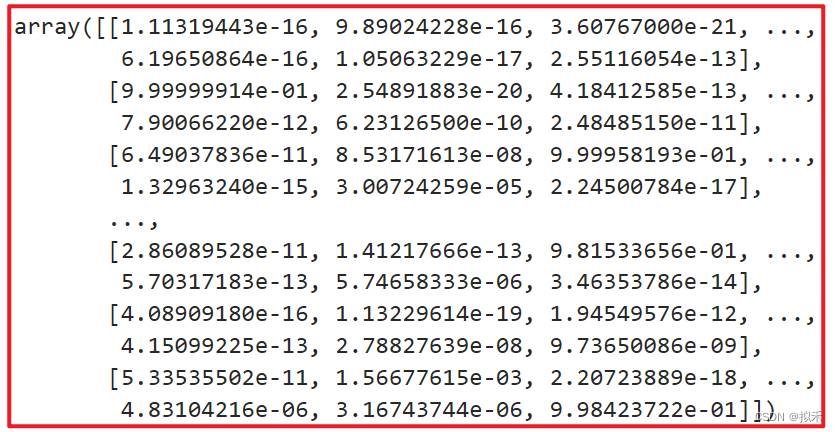

clf.predict_proba(Xtrain)

#decision_function:每个样本点到分类超平面的距离,可以衡量置信度

#对于无法输出概率的算法,如SVM,我们通常使用decision_function来输出置信度

clf.decision_function(Xtrain)

#predict:输出具体的预测标签

clf.predict(Xtrain)

对参数stack_method有:

输入"auto",sklearn会在每个个体学习器上按照"predict_proba", "decision_function", "predict"的顺序,分别尝试学习器可以使用哪个接口进行输出。即,如果一个算法可以使用predict_proba接口,那就不再尝试后面两个接口,如果无法使用predict_proba,就尝试能否使用decision_function。

输入三大接口中的任意一个接口名,则默认全部个体学习器都按照这一接口进行输出。然而,如果遇见某个算法无法按照选定的接口进行输出,stacking就会报错。

因此,我们一般都默认让stack_method保持为"auto"。从上面的我们在逻辑回归上尝试的三个接口结果来看,很明显,当我们把输出的结果类型更换成概率值、置信度等内容,输出结果的结构一下就可以从一列拓展到多列。

predict_proba

对二分类,输出样本的真实标签1的概率,一列

对n分类,输出样本的真实标签为[0,1,2,3...n]的概率,一共n列

decision_function

对二分类,输出样本的真实标签为1的置信度,一列

对n分类,输出样本的真实标签为[0,1,2,3...n]的置信度,一共n列

predict

对任意分类形式,输出算法在样本上的预测标签,一列

在实践当中,我们会发现输出概率/置信度的效果比直接输出预测标签的效果好很多,既可以向元学习器提供更多的特征、还可以向元学习器提供个体学习器的置信度。我们在投票法中发现使用概率的“软投票”比使用标签类被的“硬投票”更有效,也是因为考虑了置信度。

passthrough,将原始特征矩阵加入新特征矩阵对于分类算法,我们可以使用stack_method,但是对于回归类算法,我们没有这么多可以选择的接口。回归类算法的输出永远就只有一列连续值,因而我们可以考虑将原始特征矩阵加入个体学习器的预测值,构成新特征矩阵。这样的话,元学习器所使用的特征也不会过于少了。当然,这个操作有较高的过拟合风险,因此当特征过于少、且stacking算法的效果的确不太好的时候,我们才会考虑这个方案。

控制是否将原始数据加入特征矩阵的参数是passthrough,我们可以在该参数中输入布尔值。当设置为False时,表示不将原始特征矩阵加入个体学习器的预测值,设置为True时,则将原始特征矩阵加入个体学习器的预测值、构成大特征矩阵。

transform与属性stack_method_estimators = [("Logistic Regression",clf1), ("RandomForest", clf2)

, ("GBDT",clf3), ("Decision Tree", clf4), ("KNN",clf5)

#, ("Bayes",clf6)

, ("RandomForest2", clf7), ("GBDT2", clf8)

]final_estimator = RFC(n_estimators=100

, min_impurity_decrease=0.0025

, random_state= 420, n_jobs=8)

clf = StackingClassifier(estimators=estimators

,final_estimator=final_estimator

,stack_method = "auto"

,n_jobs=8)

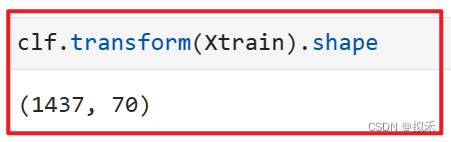

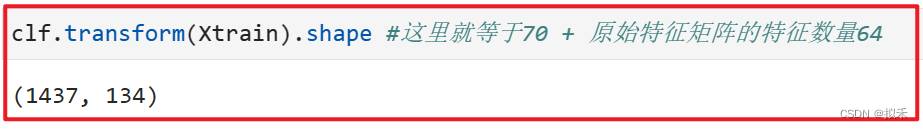

clf = clf.fit(Xtrain,Ytrain) 当我们训练完毕stacking算法后,可以使用接口transform来查看当前元学习器所使用的训练特征矩阵的结构

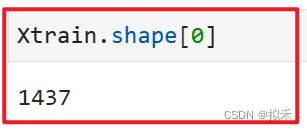

如之前所说,这个特征矩阵的行数就等于训练的样本量

因为我们有7个个体学习器,而现在数据是10分类的数据,因此每个个体学习器都输出了类别[0,1,2,3,4,5,6,7,8,9]所对应的概率,因此总共产出了70列数据。如果加入参数passthrough,特征矩阵的特征量会变得更大。

clf = StackingClassifier(estimators=estimators

,final_estimator=final_estimator

,stack_method = "auto"

,passthrough = True

,n_jobs=8)

clf = clf.fit(Xtrain,Ytrain)

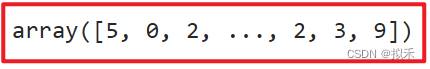

使用属性stack_method_,我们可以查看现在每个个体学习器都使用了什么接口做为预测输出:

不难发现,7个个体学习器都使用了predict_proba的概率接口进行输出,这与我们选择的算法都是可以输出概率的算法有很大的关系。

现在我们已经知道了stacking算法中所有关于训练的信息,我们可以梳理出如下训练流程:

不难发现,虽然训练的流程看起来比较流畅,但是测试却不知道从何做起,因为:

最终输出预测结果的是元学习器,因此直觉上来说测试数据集或许应该被输入到元学习器当中。然而,元学习器是使用新特征矩阵进行预测的,新特征矩阵的结构与规律都与原始数据不同,所以元学习器根本不可能接受从原始数据中分割出来的测试数据。因此正确的做法应该是让测试集输入level 0的个体学习器。

然而,这又存在问题了:level 0的个体学习器们在训练过程中做的是交叉验证,而交叉验证只会输出验证结果,不会留下被训练的模型。因此在level 0中没有可以用于预测的、已经训练完毕的模型。

为了解决这个矛盾在我们的训练流程中,存在着隐藏的步骤:

stacking的训练

stacking的测试

因此在stacking中,不仅要对个体学习器完成全部交叉验证,还需要在交叉验证结束后,重新使用训练数据来训练所有的模型。无怪Stacking融合的复杂度较高、并且运行缓慢了。

至此,我们学习完投票法和堆叠法了。

本文完整实战代码获取:模型融合实战Stacking和Blending - 知乎 (zhihu.com)