AI大模型(Large AI Models) 指参数规模超10亿的深度学习模型,其核心突破点:

# 典型模型参数对比(2023)

models = {

"GPT-3": 175*10**9,

"PaLM-2": 340*10**9,

"LLaMA-2": 70*10**9

}

✅ 参数爆炸:相比传统模型提升3-5个数量级

✅ 上下文学习:无需微调完成新任务(如GPT-3的Few-Shot Learning)

✅ 多模态融合:CLIP实现图文跨模态理解

| 时间轴 | 里程碑事件 | 技术影响 |

|---|---|---|

| 2012 | AlexNet夺冠ImageNet | CNN开启深度学习时代 |

| 2017 | Transformer架构提出 | 奠定大模型基础结构 |

| 2020 | GPT-3发布 | 展示生成式AI潜力 |

| 2022 | Stable Diffusion爆红 | 开源图像生成模型普及化 |

| 2023 | LLaMA 2开源 | 百亿参数模型平民化 |

模型效果 ∝ 参数规模 × 数据量 × 计算量

注意力机制(Transformer核心)

位置编码(处理序列数据)

稀疏激活(降低计算复杂度)

| 领域 | 应用案例 | 效果提升 |

|---|---|---|

| 软件开发 | GitHub CopilotImageNet | 代码完成效率提升55% |

| 工业质检 | 表面缺陷检测 | 准确率99.3%→99.7% |

| 医疗影像 | 病理切片分析 | 诊断速度提升20倍 |

# 典型训练成本(以70B模型为例)

├── 硬件成本:约$2,000,000

├── 数据成本:300TB文本数据

└── 能耗成本:≈500户家庭年用电量

# 使用HuggingFace加载LLaMA2

from transformers import AutoModelForCausalLM

model = AutoModelForCausalLM.from_pretrained(

"meta-llama/Llama-2-7b-chat-hf",

device_map="auto"

)

| 挑战类型 | 典型表现 | 解决方案 |

|---|---|---|

| 算力需求 | 训练需千卡GPU集群 | 模型并行+流水线并行 |

| 数据隐私 | 可能泄露训练数据 | 差分隐私+联邦学习 |

| 推理延迟 | 生成式响应延迟高 | 量化+模型裁剪 |

2024:万亿参数模型常态化

2025:多模态模型主导产业应用

2026:AI自主优化模型架构

+ 掌握分布式训练技术

+ 深入理解Transformer架构

- 避免盲目追求参数量

技术交流:你在实际项目中遇到过大模型应用的哪些挑战?欢迎评论区讨论!

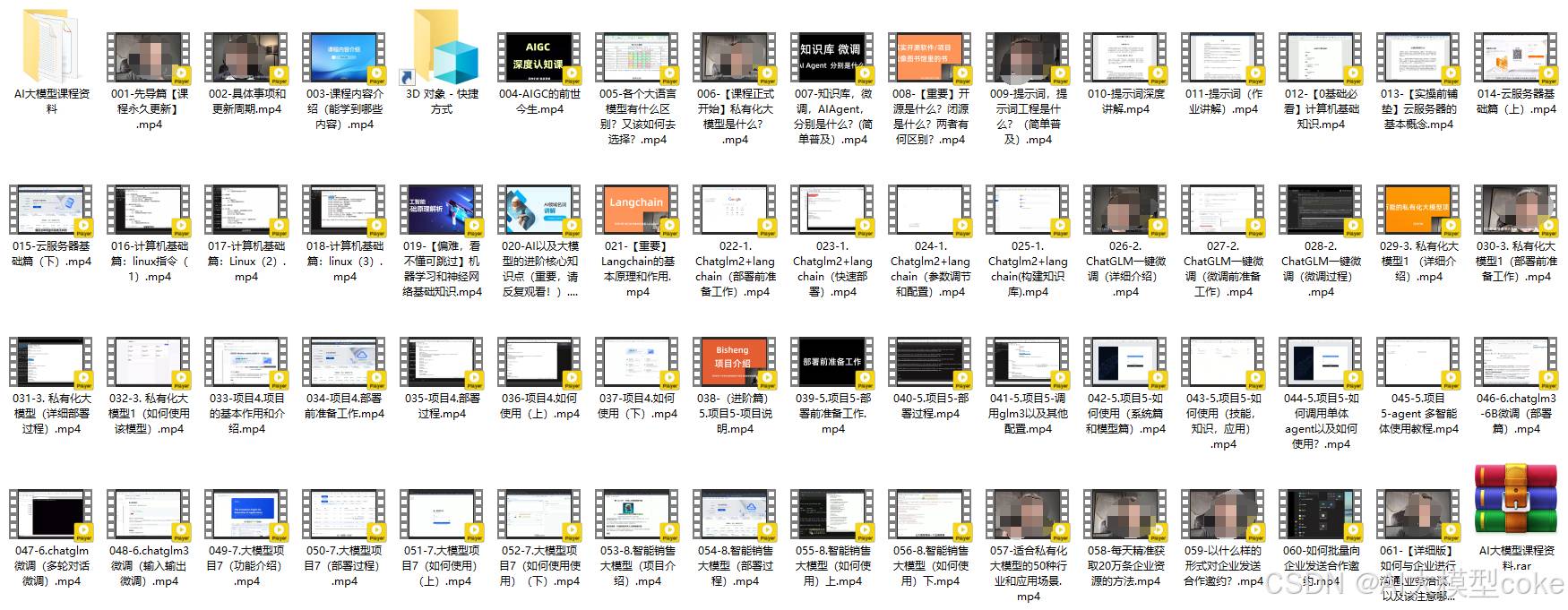

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获取

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获

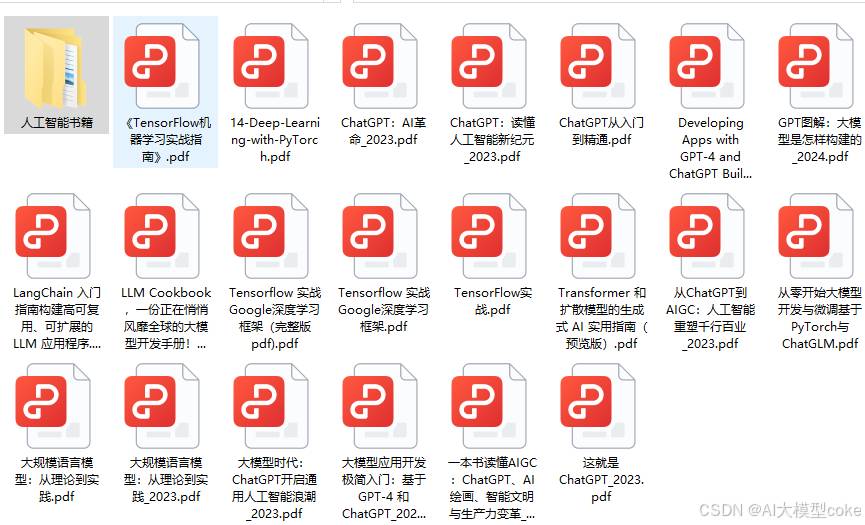

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。